NVIDIA V100是一款8年前的GPU,如今可以在eBay上以约100美元的价格购得,它竟然在AI大语言模型(LLM)任务中击败了更现代的显卡,如NVIDIA GeForce RTX 3060和AMD Radeon RX 7800 XT,展现出更强的性能和能效。

NVIDIA Volta是首个完全面向数据中心、不涉足普通消费级游戏市场的系列。Volta系列也是首次引入Tensor Core架构的GPU家族,这一架构此后成为了英伟达(NVIDIA)AI技术发展的基石。Tensor Core架构专为处理AI任务而设计,自Volta系列以来已取得了巨大的发展。然而,科技频道Hardware Haven决定测试一块8年前的NVIDIA V100 GPU,看看它在当今的AI大语言模型(LLM)中表现如何。

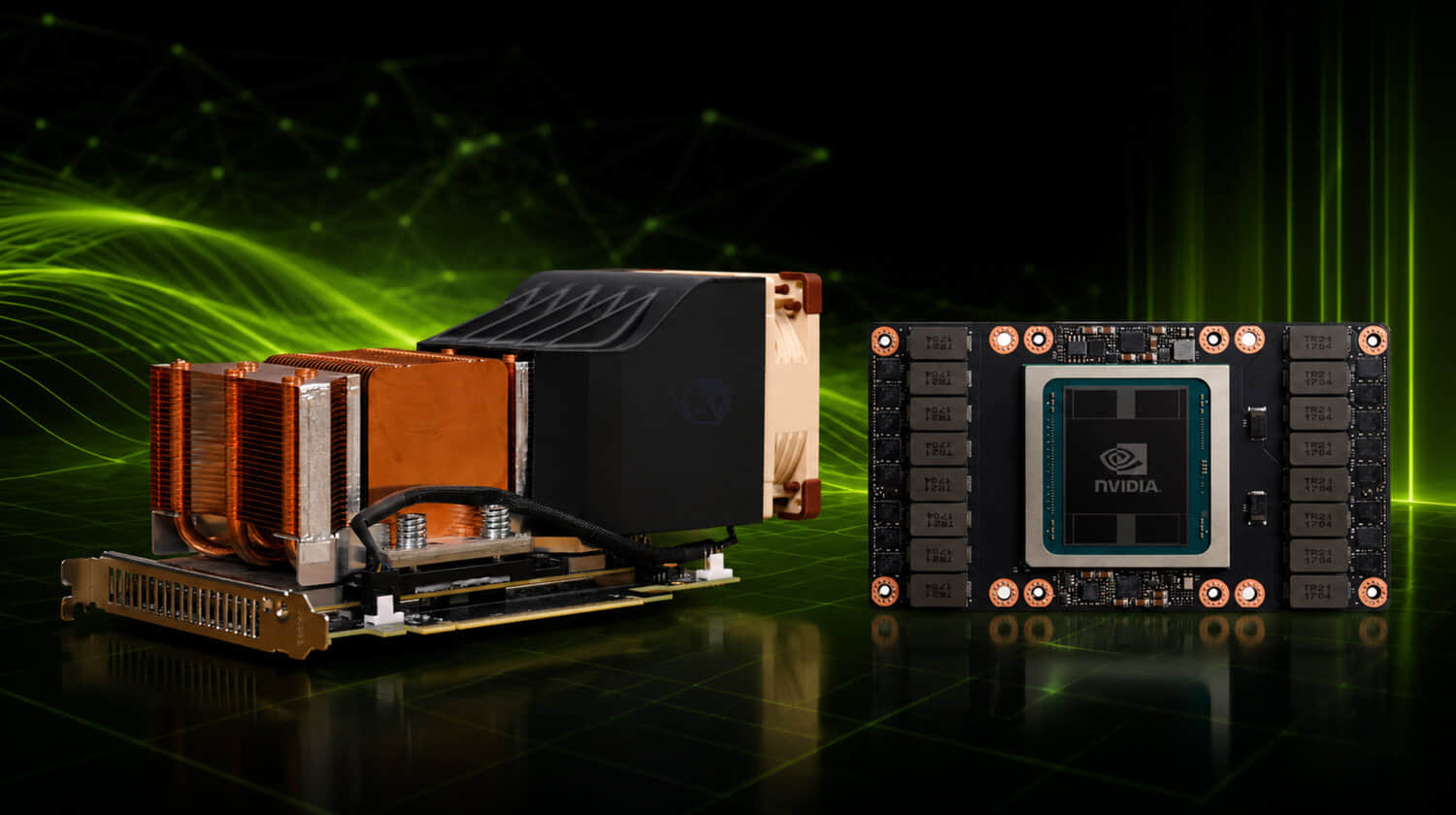

首先,让我们回顾一下NVIDIA Tesla V100 GPU的规格。Tesla V100有两种外形规格:SXM板和PCIe版本。SXM型号主要部署在数据中心,使用一种夹层连接器,可以直连电源和NVLink。这次测试的V100是SXM2型号,拥有5120个核心、320个纹理单元、128个光栅化处理单元和640个Tensor Core。它配备了6MB的二级缓存,最高可达1530 MHz的时钟频率,以及16GB或32GB的HBM2显存,显存位宽为4096-bit,提供898 GB/s的带宽。该GPU的热设计功耗(TDP)为250W,与当前超过1KW的Blackwell型号相比,显得微不足道。

当年,NVIDIA Tesla V100的售价超过10,000美元,但如今,你可以在eBay上以仅100美元的价格买到16GB版本。但主要问题不在于GPU的价格,而在于它与标准PC的兼容性。没有一款PC支持SXM2标准。这就需要一块SXM转PCIe转接卡,该转接卡自带独立的2x8-pin电源接口配置和三个4-pin风扇接口。

另一个障碍是散热解决方案。NVIDIA Tesla系列是为大型数据中心设计的,采用被动散热方式,配有一个大型散热片。GPU上的散热片和背板虽然高端,但无法在标准PC内维持7x24小时的稳定运行。这迫使这位科技博主自己设计了一个3D打印的散热导流罩,并配备了一个猫头鹰(Noctua)风扇,为散热片提供直吹气流。

GPU和所有附加组件的总成本略高于200美元,这仍然低于用于对比的型号,如NVIDIA GeForce RTX 3060 12 GB和AMD Radeon RX 7800 XT 16 GB。

第一个用于测试的AI大语言模型(LLM)是拥有200亿参数的GPT-oss。在此项测试中,搭载NVIDIA V100的系统能够生成约130词元/秒,而AMD Radeon RX 7800 XT仅能达到约90词元/秒。

相较于约5年前发布的NVIDIA GeForce NVIDIA GeForce RTX 3060 12 GB,NVIDIA V100在Gemma4:e4b(通过ollama+openwebui)的词元生成速度上快了42%。更令人印象深刻的是,这款8年前的GPU的能效表现:尽管其功耗更高,但在能效上比基于更新Ampere架构的GPU领先了12%。

该GPU还在100W功耗限制下进行了测试,在词元/秒/瓦的能效测试中再次以41%的优势领先于RTX 3060。

虽然这证明了旧款GPU在AI大语言模型(LLM)任务中仍然具备实用价值,能提供出色的性价比和能效,但它们确实需要额外的改造,这并非所有人都能操作。32GB版本的V100售价大约在400至500美元之间,但更大的显存容量可以更好地支持更大型的AI大语言模型(LLM)。有鉴于此,该科技频道计划未来进行更多测试。