DeepSeek V4已发布,带来了重大优化,包括高达1.6T的模型参数量。同时,英伟达(NVIDIA)已准备就绪,在基于NVFP4的Blackwell GPU上提供首发支持。

英伟达Blackwell NVFP4架构在DeepSeek V4上实现了大幅加速,更多优化即将到来。随着DeepSeek V4的推出,我们看到其在计算和内存需求方面实现了重大优化。更新后的AI模型在运行百万token上下文窗口时,仅需单token推理FLOPs的27%和KV缓存的10%。同时,还推出了两个新模型:一个是参数量高达1.6T的Pro版本,另一个是参数量为284B的Flash版本。

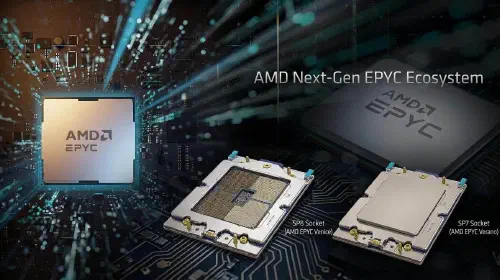

随着此次发布,英伟达展示了其Blackwell GPU在DeepSeek V4上的首发支持和性能。该公司表示,Blackwell GPU提供了运行V4所提供的1M长上下文推理和万亿参数AI模型所需的规模和低延迟性能。

从基于英伟达Blackwell的数据中心部署,到托管的NIM微服务和微调工作流程,英伟达提供了一系列选项,用于在不同开发和部署阶段集成DeepSeek及其他开源模型。英伟达是开源生态系统的积极参与者,已以开源许可形式发布了数百个项目。英伟达致力于优化社区软件和开源模型,让用户能够广泛分享在AI安全性和鲁棒性方面的工作。

在性能展示中,英伟达演示了每个GPU(GB300或Blackwell Ultra)接近3500 TPS的吞吐量,这仅是初步数据,随着对协同设计栈的进一步优化,该数据有望继续提升。英伟达Blackwell技术栈提供了一系列专为V4这类模型设计的技术,包括NVFP4、Dynamo、优化的CUDA内核、先进的并行化技术等。

DeepSeek V4的关键在于应用了FP4(MXFP4)量化,该技术用于加速模型部署和推理过程。通过FP4,DeepSeek V4模型减少了内存流量和采样延迟。

值得强调的是,华为最新的Ascend芯片——计划于2026年推出的Ascend 950PR和Ascend 950DT,均配备了MXFP4指令集。这表明DeepSeek V4也将完全兼容中国的国产AI芯片。随着英伟达的持续优化,未来的模型将获得开箱即用的强大生态系统支持。