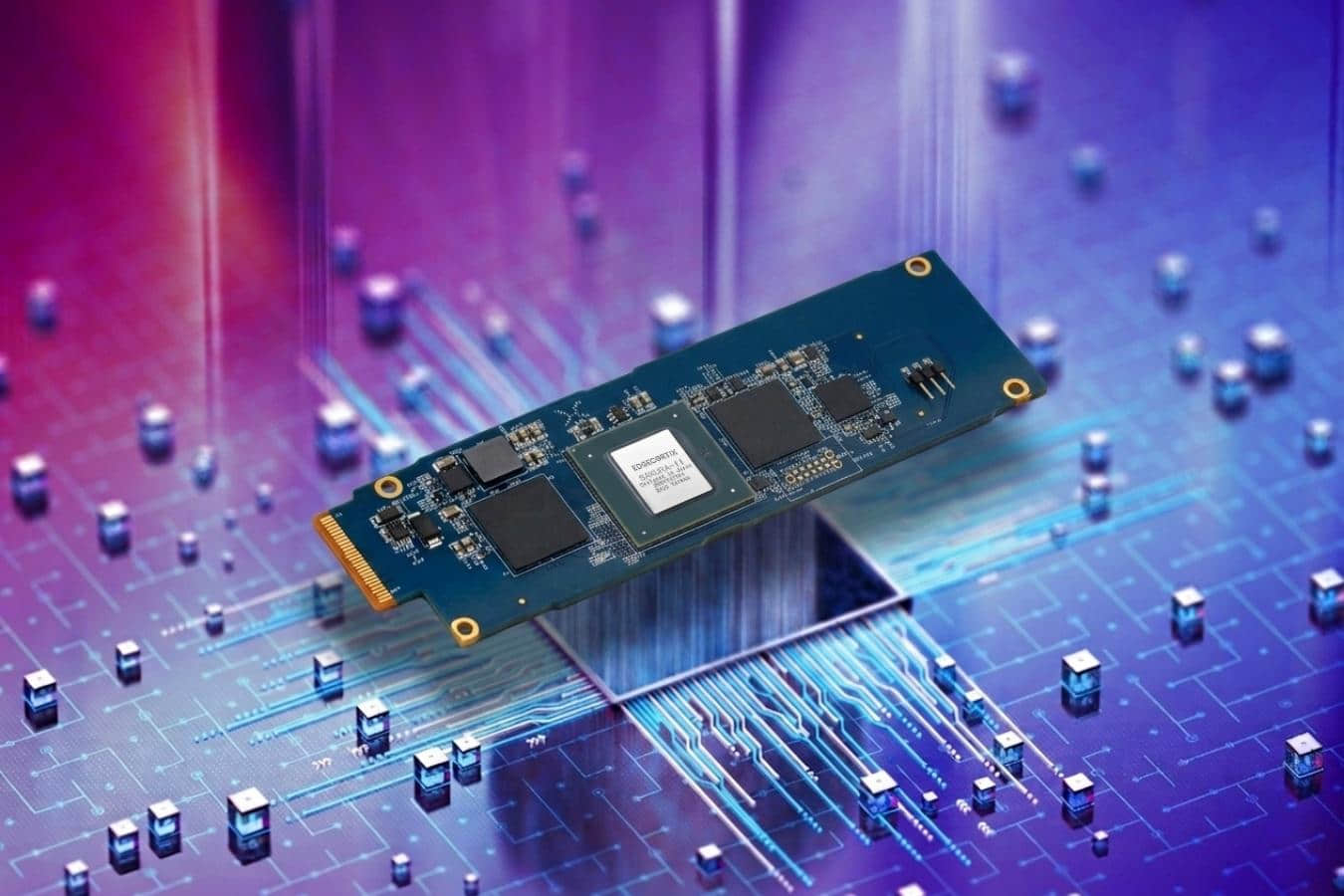

随着本地AI代理的兴起,许多公司纷纷推出独具特色的AI产品。Unigen便是其中之一,它发布了Amaretti E1.S AI模块。这款微型模块兼容标准的M.2接口,外形酷似普通固态硬盘,却蕴含着强大的AI处理能力。

该模块基于EdgeCortix公司的SAKURA-II AI加速器打造。这款加速器最初为低功耗AI平台设计,旨在为树莓派5(Raspberry Pi5)及其他基于ARM架构的产品带来AI能力。其加速器芯片集成了一个NPU,可提供60 TOPS的INT8算力和30 TFLOPS的BF16算力。它配备了双64位LPDDR4x内存控制器,并拥有20MB的片上SRAM缓存。其19x19 BGA封装功耗大约在8-10瓦。

Unigen所做的,就是将SAKURA-II AI加速器集成到一块E1.S规格的板卡上,并配备了高达32 GB的惊人内存容量。该模块提供16 GB和32 GB两种版本,最高可提供68 GB/s的带宽。Amaretti模块的额定功耗为10瓦,这意味着其能效达到了每瓦6 TOPS。

在性能方面,32 GB的内存容量使得该模块能够轻松运行参数规模高达200亿的AI大语言模型。这对于需要运行生成式AI和智能体AI工作流的低功耗AI解决方案而言,是理想的选择。此外,这些模块可以堆叠安装在多个M.2插槽中,从而进一步提升整体性能。EdgeCortix已经提供了更高端的PCIe配置方案,包含两颗此类芯片及更多功能,但M.2解决方案无疑是一个有趣的选择。

许多个人电脑、台式机和笔记本电脑都有闲置的M.2插槽。如果你正在寻求本地化AI方案,并希望提升系统速度,那么这些模块将非常具有吸引力。

据Unigen介绍,该AI模块支持所有最新的AI框架,如TensorFlow、PyTorch、ONNX和Hugging Face。该模块的主要亮点包括:

E1.S AI模块

AI加速器:SAKURA-II

采用风冷双CPU服务器时,最高可提供1920 TOPS的推理性能

与训练用GPU相比,使用TPU可节省20%的功耗

支持参数规模高达200亿的生成式AI大语言模型

14周的交付周期,远低于GPU服务器的典型交付时间

每个模块最高32GB内存

Unigen出货的Amaretti E1.S AI模块均预装了散热器。目前尚无价格信息,但其内存容量或许能为我们提供一些预期。