据PCWorld报道,来自英特尔(Intel)、英伟达(Nvidia)和AMD的神经纹理压缩技术,有望大幅减小游戏文件体积并降低PC玩家的显存占用。

英特尔的TSNC技术可将纹理压缩高达17倍,而英伟达的NTC技术则能将显存占用减少超过85%,这有助于老旧显卡运行现代游戏。微软(Microsoft)计划将其集成到DirectX中,英特尔则预计在今年发布Alpha版SDK。这或许能解决高企的内存成本和存储空间问题。

PC玩家一直面临一个难题:为了呈现更逼真的体验和画面,更强大的游戏需要更强大的硬件资源。但玩家们能否避免为此支付高昂的升级费用呢?

纹理压缩可能是一个解决方案,它既能缩小游戏体积,也能让游戏适配那些老旧、廉价显卡的有限显存。英伟达和英特尔都在推进相关技术,预计未来几个月内,新旧硬件都可能从中受益。总而言之,这对于持续存在的内存和显存短缺问题是一个令人兴奋的潜在解决方案,这种短缺正推高硬件(包括显卡)价格并阻碍新显卡的发布。

两家公司最近几周概述了各自的计划:英特尔本周末宣布了其神经纹理压缩SDK,而英伟达在GTC 2026大会上的相关演讲也展示了如何利用其硬件有效压缩纹理。

3D图形本质上像一场木偶戏:传统上,每个物体都由一个表面框架构成,然后游戏设计师告诉你的PC如何用单独打光和着色的纹理来“覆盖”它们。正是这些纹理数据构成了游戏体积的大头,因为每个物体都可能应用了多张“贴图”。

一块看起来逼真的“砖块”,其代码会告诉游戏砖块的哪些部分处于阴影中,哪些部分粗糙或光滑,以及这些差异如何影响砖块本身的颜色。这些就是所谓的“贴图”。它们至关重要:像《霍格沃茨之遗(Hogwarts: Legacy)》这样的游戏可能需要58GB的数据;其“高清纹理包”可能额外需要18.3GB。纹理在内存中的加载和卸载也可能导致游戏卡顿,因此减小纹理尺寸也能改善游戏运行体验。

正致力于构建一个能实现此功能的DirectX API的微软已经表示,计划在DirectX中内置对神经纹理压缩的支持。该公司预计开发者会希望使用其所谓的“小模型”和“场景模型”来实现下一代场景渲染,这可能包括神经光照和神经纹理压缩。在这两种情况下,都将使用AI来计算场景应如何绘制和着色,而不是由硬件实际执行所有这些计算。

英特尔的工程师展示了其纹理集神经压缩(Texture Set Neural Compression)技术的两种变体,根据所用方法,可将纹理压缩至未压缩数据的9倍或超过17倍。据英特尔图形工程师玛丽莎·杜波依斯(Marissa Dubois)介绍,纹理可以在多个环节解压缩:在安装时、游戏加载时,甚至更晚。与其他压缩技术类似,它利用数据纹理贴图中的相似性来尝试减小数据尺寸。

英特尔的演示指出,存在一种被称为“感知误差”的情况:第二种17倍变体的误差约为6-7%,第一种则为5%。两种方法都可以使用英特尔锐炫(Intel Arc)GPU内部的XMX核心,或者“回退”到可在其他CPU甚至GPU上使用的更通用实现方案。英特尔表示,在Panther Lake平台上,XMX推理速度比回退方法快约3.4倍。

英特尔工程师表示,目前这还只是一个演示。一个Alpha版软件开发工具包(SDK)计划于今年晚些时候发布,随后是Beta版,最终正式版。

英伟达已经发布了颇具争议的图形增强技术DLSS 5,它引入生成式AI来“提升”游戏画质——尽管DLSS 5的“提升”效果备受质疑。而英伟达的神经纹理压缩(Neural Texture Compression)技术则是明确确定性的,这意味着它总能重建开发者设计的原始纹理。

英伟达确实使用一个小型神经网络在其Tensor核心上运行来重建数据。其RTX神经纹理压缩SDK现已可供开发者使用。

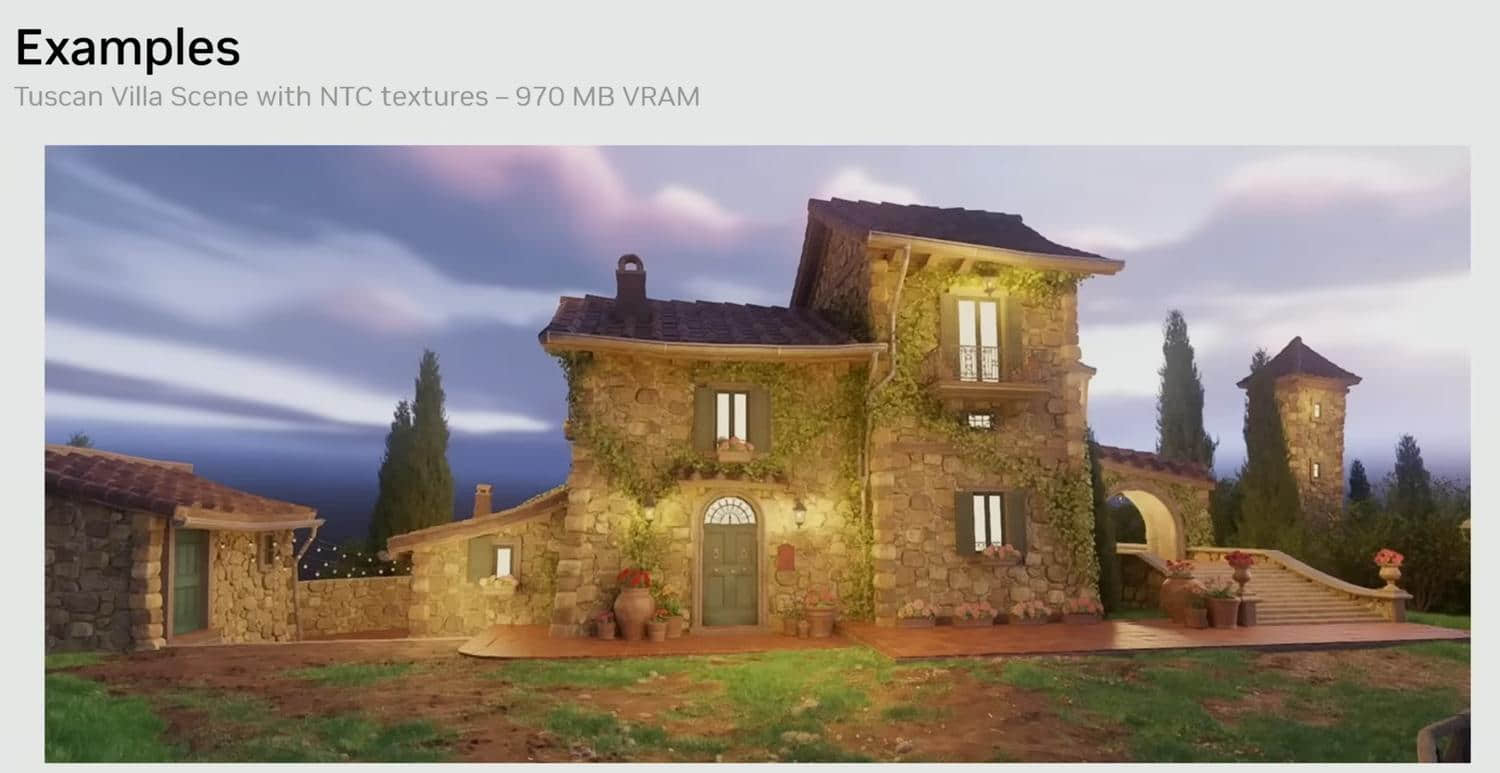

英伟达展示了两个演示:神经纹理压缩和神经材质。演示表明,NTC可将一个原本需要6.5GB显存的场景压缩至仅970MB。目前尚不清楚英伟达在神经材质方面的具体做法,但看起来该公司正试图告诉GPU某种材质的实际属性,然后压缩这些指令。据英伟达称,显卡随后将实质性地构建该材质,使处理速度提升1.4倍到7.7倍。

AMD尚未提供用于降低游戏内存占用的SDK。不过,在2024年,该公司发表了一篇关于神经纹理块压缩的论文,可将纹理尺寸削减70%。

总而言之,神经压缩技术目前还不能让你受益。但它似乎距离我们只有几个月之遥了……而且坦白说,它可能来得越快越好。