在人工智能领域,英伟达当前最大的竞争对手并非AMD或英特尔,而是正在快速崛起的谷歌。值得玩味的是,英伟达首席执行官黄仁勋早已洞察这一趋势。

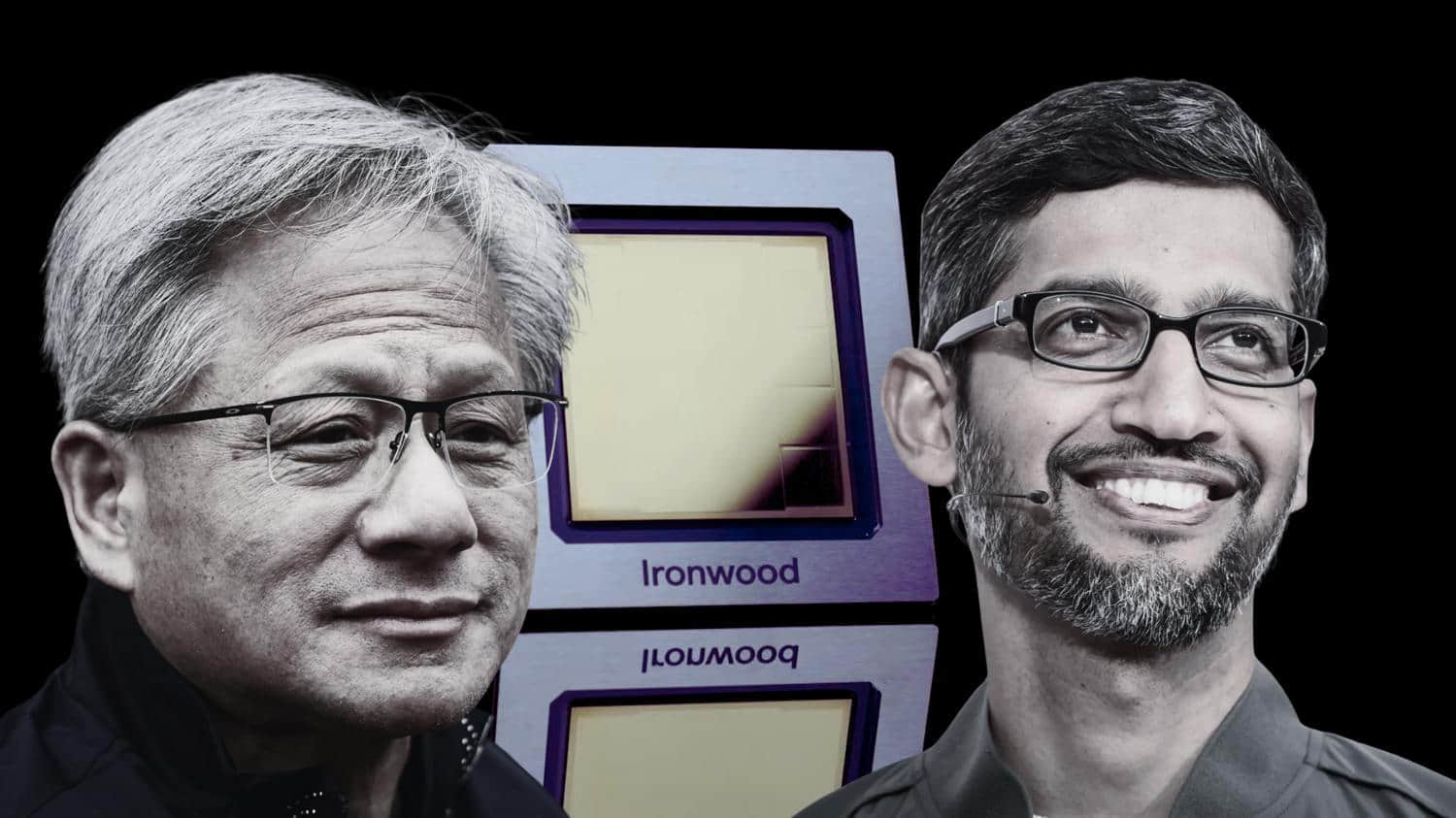

这一结论或许初看令人意外,但谷歌实为AI硬件竞赛中最资深的参与者——早在2016年就推出了首代定制AI芯片TPU,时间远早于AMD、英伟达和英特尔。这家科技巨头上周发布的第七代“铁木”TPU震撼业界,正式确立了“英伟达对阵谷歌”的AI霸主争夺战格局。我们将通过深度对比谷歌最新铁木TPU与英伟达方案,解析这一论断的深层依据。

谷歌铁木TPU:192GB HBM内存与跨代性能飞跃

即将全面投入应用的铁木TPU被谷歌定义为“专注推理”的解决方案,宣称将开启通用计算推理性能的新纪元。TPU v7(铁木)精准把握了从模型训练向推理转型的行业趋势,其芯片规格专为“推理时代”优化,主要特性包括:

较TPU v5p峰值性能提升10倍

对比TPU v6e(延龄草),训练与推理性能均提升4倍

成为谷歌迄今能效最高的自研芯片

具体规格方面,每颗铁木芯片集成192GB HBM3e内存,带宽达7.4TB/s,峰值算力高达4,614 TFLOPS,较TPUv4实现16倍提升。更重要的是,通过铁木TPU超级模块整合9,216颗芯片,在FP8计算负载下可实现42.5 EFLOPS的聚合算力。该规模证明谷歌的互联解决方案已在扩展性方面超越NVLink技术。

铁木超级模块的互联革命

谷歌采用芯片间互联技术构建纵向扩展网络,支持43个计算块(每块含64颗芯片)通过1.8PB网络互联。通过3D环面架构与定制网卡实现高密度互联,在扩展性与互联密度方面超越NVLink,使超级模块成为颠覆性方案。

定制芯片能否终结英伟达AI霸权?

要理解铁木TPU在推理时代的意义,需明确“思维模型”正在成为新焦点。虽然模型训练曾是AI产业主线,造就了英伟达在大科技公司的首选地位,但随着主流模型完成部署,推理查询量正呈指数级超越训练任务。

推理性能不仅关乎算力峰值,更取决于延迟、吞吐量、能效与单次查询成本等核心指标。正是这些维度使得谷歌在AI竞赛中的优势逐渐明晰:铁木搭载的集成内存容量与英伟达Blackwell B200 AI GPU持平,但超级模块的9,216颗芯片集群可实现内存容量的量级突破。

大内存对推理至关重要——它能降低芯片间通信开销,改善大模型推理延迟,这正是铁木的吸引力所在。其架构专为推理优化,聚焦低延迟与高能效。在超大规模推理场景中,需要成千上万颗芯片提供24/7服务,云服务商更关注部署与运营成本而非峰值性能。铁木较前代提升2倍能效,使谷歌TPU在推理场景中更具成本优势。

AI竞赛正从“算力角逐”转向“低成本、低功耗、低延迟的高并发查询服务”,这为谷歌创造了超越英伟达的新赛道。更关键的是,铁木将作为谷歌云专属服务,可能形成生态闭环——这对绿队长期垄断的AI市场构成潜在致命打击。谷歌TPU的代际进化已显现强大竞争力,足以敲响英伟达的警钟。

当然,英伟达并未坐视推理时代来临,通过鲁宾CPX机架级解决方案试图建立优势。但随着时间的推移,谷歌正确立其“真正劲敌”的地位,而英特尔与AMD暂时落后。

在BG2播客中,黄仁勋曾如此评价谷歌TPU:“关于GPU与ASIC的争论是关键议题之一……谷歌在一切开始前就启动了TPU1项目……ASIC开发者面临的挑战在于——TPU已发展到第七代,他们同样面临技术挑战,这项工作的难度超乎想象。”