Signal 总裁梅雷迪思·惠特克(Meredith Whittaker)在周五发出警告,代理型人工智能(agentic AI)可能会对用户的隐私构成威胁。

在德克萨斯州奥斯汀举办的西南偏南(SXSW)大会上,惠特克作为安全通信领域的倡导者,将人工智能代理的使用形象地比喻为“把大脑装进罐子里”。她指出,这种新兴的计算模式——人工智能代表用户执行各种任务——在隐私和安全方面存在严重问题。

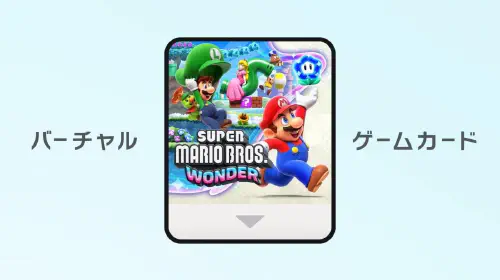

惠特克解释说,人工智能代理被宣传为一种能够为用户生活增添便利的工具,它可以通过处理各种在线任务来实现这一目标。例如,人工智能代理可以帮你查找音乐会信息、预订门票、在日历上安排活动,甚至向朋友发送已预订的提醒信息。她调侃道:“我们是不是可以把大脑装进罐子里,因为这些任务都交给人工智能去完成,我们自己都不用动手了呢?”

然而,为了完成这些任务,人工智能代理需要获取大量权限。它需要访问用户的网络浏览器并进行操作,还需要访问信用卡信息以支付门票费用、日历以及消息应用程序,以便向朋友发送短信。惠特克警告说:“它需要像拥有系统最高权限一样,访问每一个数据库,而且很可能是以明文形式访问,因为目前还没有加密模型能够实现安全访问。”

她进一步指出,如果涉及足够强大的人工智能模型,这些操作几乎不可能在本地设备上完成。数据很可能会被发送到云端服务器进行处理,然后再返回设备。惠特克强调:“这就引发了严重的安全和隐私问题。这种围绕代理的炒作,最终可能会打破应用层与操作系统层之间的‘血脑屏障’,将所有独立服务整合在一起,混淆它们的数据。”

她还提到,如果像 Signal 这样的消息应用程序与人工智能代理集成,用户的隐私将受到威胁。因为代理需要访问应用程序来发送短信,同时还需要将数据拉回以总结这些信息。

此前,惠特克在小组讨论中提到,人工智能行业是建立在大规模数据收集的监控模式之上的。她指出,“越大越好”的人工智能范式——即数据越多越好——可能会带来一些不良后果。她警告说,代理型人工智能可能会以“神奇的精灵机器人将照顾生活琐事”的名义,进一步削弱用户的隐私和安全。